Künstliche Intelligenz ist im Studienalltag angekommen. Laut dem KI Monitor 2025 des Hochschulforums Digitalisierung befassen sich 97 Prozent der deutschen Hochschulen mit den Auswirkungen von KI auf Prüfungen, und 87 Prozent haben ihre Eigenständigkeitserklärungen bereits angepasst. Trotzdem herrscht an vielen Universitäten Unsicherheit: Was genau ist erlaubt, was nicht? Und wie unterscheiden sich die Regelungen von Hochschule zu Hochschule?

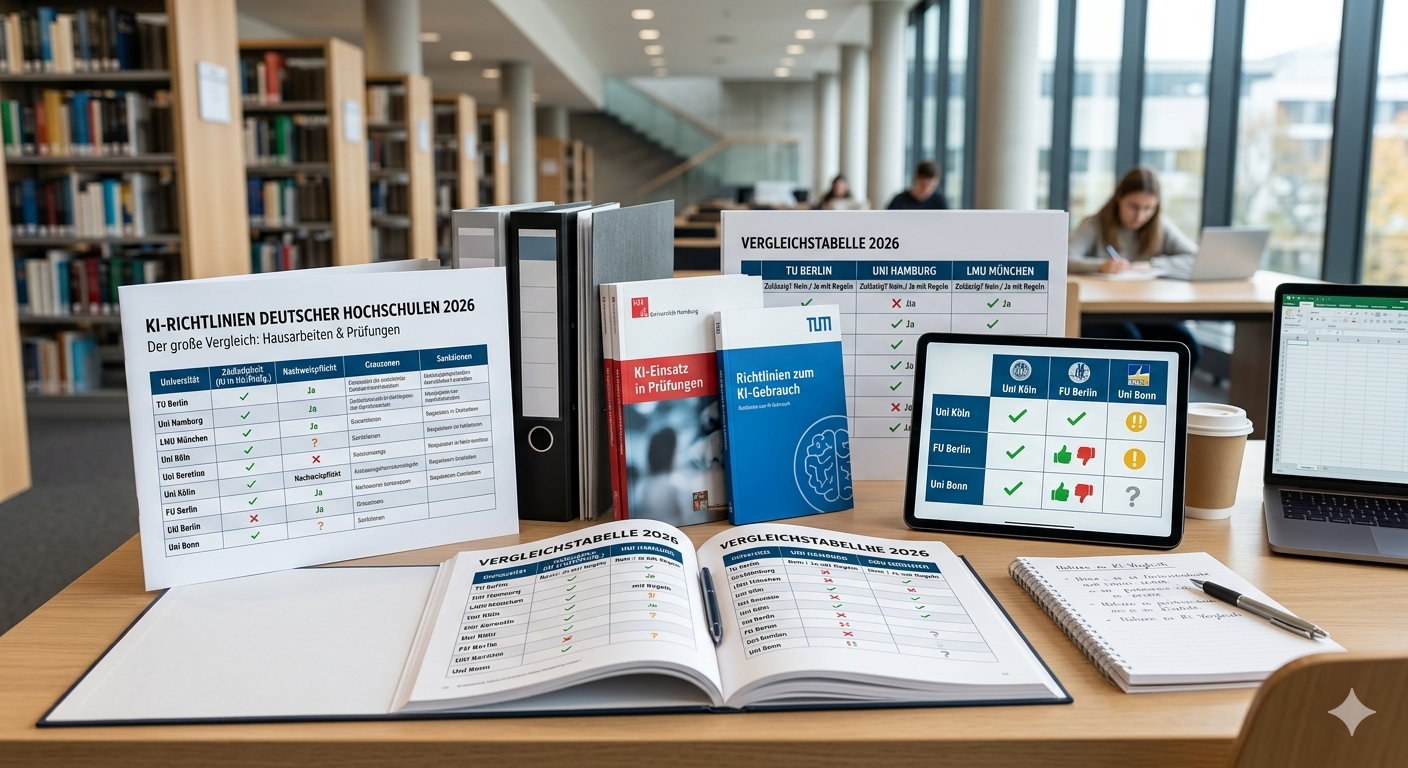

Dieser Artikel liefert einen strukturierten Überblick über die KI-Richtlinien deutscher Universitäten im Jahr 2026. Ziel ist es, dir als Studierendem eine verlässliche Orientierungshilfe zu bieten, damit du KI-Tools wie ChatGPT, fastwrite oder DeepL verantwortungsvoll nutzen kannst, ohne deine akademische Integrität zu gefährden.

Der Status quo: Wo stehen deutsche Hochschulen?

Die Landschaft der KI-Richtlinien in Deutschland ist fragmentiert. Rund 15 Prozent der Hochschulen haben bereits eine eigene KI-Strategie verabschiedet, weitere 50 Prozent befinden sich im Entwicklungsprozess. Gleichzeitig haben nur etwa 30 Prozent aller Hochschulen überhaupt offizielle Leitlinien zur KI-Nutzung veröffentlicht. Das bedeutet: An der Mehrheit der deutschen Universitäten fehlen klare, universitätsweite Vorgaben.

Was an vielen Hochschulen bereits gilt, ist die Pflicht zur KI-Kompetenz. Seit Februar 2025 verlangt die EU-KI-Verordnung (AI Act), dass alle Betreiber von KI-Systemen sicherstellen, dass ihre Nutzer ausreichend geschult sind. Für Hochschulen heißt das konkret: Sie müssen dafür sorgen, dass Studierende und Beschäftigte verstehen, was der Einsatz von KI bedeutet. Weitere Vorgaben der KI-Verordnung, etwa zu KI mit allgemeinem Verwendungszweck und zu Hochrisiko-Systemen, treten im August 2026 in Kraft.

Die wichtigsten Regelungsmodelle im Vergleich

Betrachtet man die aktuelle Hochschullandschaft, lassen sich drei grundlegende Modelle identifizieren, wie Universitäten den KI-Einsatz steuern.

Modell 1: Universitätsweite Richtlinie

Einige Hochschulen haben eine zentrale, verbindliche KI-Policy entwickelt. Die Universität Freiburg etwa hat eine umfassende KI-Policy für die Forschung veröffentlicht, die klare Empfehlungen zur Kennzeichnungspflicht, zur Verantwortung für KI-generierte Inhalte und zur Vermeidung von Bias enthält. Die Universität Osnabrück stellt detaillierte Handlungsempfehlungen bereit, einschließlich standardisierter Eigenständigkeitserklärungen in deutscher und englischer Sprache. Die Universität Regensburg hat ihre KI-Leitlinien direkt an die EU-KI-Verordnung gekoppelt und bietet fakultätsspezifische Regelungen an, etwa für Physik, Rechtswissenschaften und Katholische Theologie.

Der Vorteil dieses Modells ist die Klarheit. Studierende wissen genau, was gilt, und können sich darauf verlassen, dass die Regelungen hochschulweit konsistent sind.

Modell 2: Dezentrale Regelung auf Fakultäts- oder Dozentenebene

An vielen Universitäten, darunter große Einrichtungen wie die LMU München oder die Universität Leipzig, gibt es keine zentralen KI-Richtlinien. Stattdessen entscheiden einzelne Fakultäten oder sogar einzelne Dozierende, ob und wie KI eingesetzt werden darf. An der LMU München zum Beispiel existieren bislang nur Empfehlungen; die konkrete Entscheidung über den KI-Einsatz wird auf Ebene der Fakultäten und Dozierenden getroffen.

Das Problem dieses Ansatzes: Studierende müssen für jede Veranstaltung einzeln klären, welche Regeln gelten. Die Universität Bamberg hat deshalb einen KI-Policy-Generator entwickelt, mit dem Lehrende individuelle Richtlinien für ihre Veranstaltungen erstellen können. Kritiker warnen allerdings vor einem daraus resultierenden Policy-Chaos, wenn an einer Hochschule jeder Lehrstuhl eine eigene, mehrseitige Richtlinie verwendet.

Modell 3: Abwartende Haltung ohne formale Regelung

Rund 20 Prozent der deutschen Hochschulen verzichten derzeit auf klare Regeln. Die Universität Köln etwa hat bisher keine spezifischen Vorschriften zur KI-Nutzung. Studierenden wird empfohlen, sich bei ihren Dozierenden zu erkundigen. Die Ruhr-Universität Bochum befand sich lange in der Planungsphase und hat mittlerweile mit der Einführung von GPT@RUB und einem FAQ begonnen, eine strukturierte Grundlage zu schaffen. Die Universität Leipzig hat ebenfalls noch keine spezifischen Regelungen veröffentlicht.

Was die Richtlinien typischerweise regeln

Unabhängig vom gewählten Modell adressieren die meisten KI-Richtlinien eine Reihe wiederkehrender Themen.

Die Kennzeichnungspflicht ist der am häufigsten geregelte Aspekt. Fast alle Hochschulen, die überhaupt Richtlinien haben, verlangen, dass der Einsatz von KI-Tools transparent gemacht wird. Das umfasst in der Regel eine Angabe in der Eigenständigkeitserklärung, eine Beschreibung, welches Tool für welchen Zweck verwendet wurde, und bei manchen Hochschulen auch eine Dokumentation der verwendeten Prompts.

Bei der Frage, welche KI-Tools erlaubt sind, gibt es deutliche Unterschiede. Manche Hochschulen stellen eigene, datenschutzkonforme KI-Zugänge bereit. 77 Prozent der Hochschulen arbeiten an solchen Lösungen, häufig über Plattformen wie HAWKI oder Academic Cloud. Die Universität Regensburg bietet zum Beispiel Microsoft Copilot und DeepL über ihre eigene Infrastruktur an. Andere Hochschulen überlassen die Tool-Wahl den Studierenden, was Fragen der Chancengleichheit aufwirft, da nicht alle den gleichen Zugang zu kostenpflichtigen Versionen haben.

Im Bereich Prüfungsrecht hat sich am meisten bewegt. 97 Prozent der Hochschulen beschäftigen sich aktiv mit den Auswirkungen von KI auf Prüfungen. Allerdings haben nur 43 Prozent ihre Prüfungsordnungen tatsächlich angepasst. Es entsteht also eine Lücke zwischen dem Bewusstsein für das Problem und der formalen Umsetzung.

Hochschulvergleich: Große staatliche Universitäten im Detail

Technische Universität Berlin: Die TU Berlin stellt umfangreiche Ressourcen und Empfehlungen bereit und hebt insbesondere Datenschutzaspekte hervor. Die Nutzung von ChatGPT ist erlaubt, solange akademische Standards eingehalten werden. Studierende werden aufgefordert, keine sensiblen Daten in KI-Tools einzugeben. Als Orientierungshilfe dient die juristische Bewertung durch die Ruhr-Universität Bochum in Zusammenarbeit mit der WWU Münster, deren zentrale Erkenntnis lautet: Ein generelles Verbot von KI-Schreibtools ergibt keinen Sinn.

Freie Universität Berlin: Der Fachbereich Informatik hat eine konkrete KI-Handlungsempfehlung veröffentlicht, die als Mindeststandard für schriftliche Arbeiten dient. Der Einsatz von KI-Werkzeugen ist grundsätzlich als Hilfsmittel erlaubt, wobei die FU ihren eigenen Dienst KI.Assist@FU empfiehlt. Ausdrücklich verboten ist das Einreichen von KI-generierten Inhalten als eigene Arbeit ohne Kennzeichnung, was als Täuschungsversuch gewertet wird.

Humboldt-Universität zu Berlin: Die HU hat eigene Empfehlungen zur Nutzung von KI in Studienleistungen und Prüfungen veröffentlicht. Diese betonen die Eigenverantwortung der Studierenden und die Notwendigkeit, alle Hilfsmittel und Quellen anzugeben.

Goethe-Universität Frankfurt: Hier steht das bestehende Prüfungsrecht im Vordergrund. Maßgeblich ist das Gebot der Eigenständigkeit der Leistung. Die Universität empfiehlt Lehrenden, KI gezielt in Aufgabenstellungen einzubinden und klar festzulegen, welche Teile einer Prüfungsleistung zwingend von den Studierenden selbst erbracht werden müssen.

Universität Hamburg: Die Regelungen befinden sich aktuell noch in einer Testphase. Studierende sollten sich bei ihren jeweiligen Fachbereichen erkundigen, da es noch keine einheitliche universitätsweite Vorgabe gibt.

RWTH Aachen: Die RWTH hat eine Checkliste zum rechtskonformen Umgang mit generativen KI-Systemen entwickelt, die als Vorlage von anderen Hochschulen übernommen wird, etwa von der Universität Osnabrück.

Universität Freiburg: Vorreiter mit einer vollständigen KI-Policy für die Forschung. Die Universität betont ausdrücklich, dass die Policy unter dem Zeichen der Sensibilisierung und Ermöglichung steht, nicht des Verbotes. Im Intranet stehen Mitarbeitenden datenschutzkonforme KI-Tools über die Plattformen HAWKI und Galaxy zur Verfügung.

Universität Tübingen: Gehört zu den Hochschulen mit vergleichsweise klaren Vorgaben und hat früh auf einheitliche Regelungen gesetzt.

Universität Kassel: Wurde durch das Urteil des Verwaltungsgerichts Kassel im Februar 2026 bundesweit bekannt. Die Universität hatte den KI-Einsatz in den betroffenen Prüfungen explizit untersagt. Das Gericht bestätigte den Ausschluss zweier Studierender von der Prüfungswiederholung wegen schwerer Täuschung durch verbotene KI-Nutzung. Das Urteil ist noch nicht rechtskräftig, setzt aber ein deutliches Signal.

Universität Marburg: Hier wird vor allem didaktisch argumentiert. Lehrende sollen für schriftliche Arbeiten den maximalen Umfang an KI-generiertem Text festlegen. Gute wissenschaftliche Praxis erfordere, dass KI-generierte Textteile als solche gekennzeichnet werden. Die inhaltliche Verantwortung verbleibe jeweils bei den Nutzenden.

Private Hochschulen: IU, FOM und Hochschule Fresenius

Besonders interessant ist die Situation an privaten Hochschulen, die oft schneller auf neue Entwicklungen reagieren als staatliche Einrichtungen.

IU Internationale Hochschule: Mit über 130.000 Studierenden Deutschlands größte Hochschule, hat die IU bereits im März 2023 per Rektoratsbeschluss die Nutzung von KI-Chatbots im akademischen Kontext erlaubt und ihre Studierenden sogar ermutigt, Tools wie ChatGPT einzusetzen. Die IU sieht KI-Tools als Recherchetools für Basisinformationen, Ideenfindung, Strukturierung und Übersetzung. Gleichzeitig macht die Hochschule klar: Die Grundsätze des wissenschaftlichen Arbeitens gelten unverändert. Studierende müssen nachweisen, dass sie ein Thema wissenschaftlich-methodisch bearbeiten können. Der Lerneffekt liegt laut der IU vor allem in der kritischen Auseinandersetzung mit dem KI-Tool und seinen Ergebnissen. Zusätzlich hat die IU mit Syntea einen eigenen KI-Lernassistenten entwickelt, dessen Antworten direkt aus der virtuellen Lernbibliothek stammen und von Tutoren überprüft werden.

FOM Hochschule: Deutschlands größte private Hochschule für Berufstätige verfolgt einen pragmatischen Ansatz. Die FOM gibt klare Richtlinien zur KI-Kennzeichnung vor: Alle Passagen, die mithilfe von KI generiert oder maßgeblich unterstützt wurden, sind eindeutig im Fließtext zu kennzeichnen. Verwendete KI-Tools müssen mit Produktname, Anbieter, URL und Zugriffsdatum im Literaturverzeichnis aufgeführt werden. Die Hochschule fördert die Auseinandersetzung mit KI auch inhaltlich und bietet einen eigenen Bachelor-Studiengang in Angewandter Künstlicher Intelligenz an. In Interviews betonen FOM-Dozenten, dass sie nichts sehen, was man verbieten sollte, solange die Möglichkeiten und Grenzen der Technologie klar gemacht werden.

Hochschule Fresenius: Die Hochschule Fresenius hat mit dem Projekt NextGeneration:AI in Kooperation mit Microsoft eine eigene datenschutzkonforme KI-Infrastruktur aufgebaut. Über Microsoft Azure erhalten alle Hochschulbeteiligten ein festes monatliches Kontingent an KI-Credits, die für verschiedene Sprachmodelle genutzt werden können. Das System lässt sich jederzeit um weitere Modelle wie Mistral oder Claude erweitern. Zusätzlich bietet die Hochschule einen Zertifikatskurs zu Generativer KI und ChatGPT an, der mit 5 ECTS-Punkten kreditiert wird.

Was bedeutet der EU AI Act für dein Studium?

Die europäische KI-Verordnung wirkt sich direkt auf den Hochschulbereich aus. Seit Februar 2025 gelten die ersten Verbote bestimmter KI-Praktiken. Im August 2026 treten die Regelungen zu KI mit allgemeinem Verwendungszweck und zu Hochrisiko-Systemen in Kraft.

Für Studierende besonders relevant: Die KI-Verordnung stuft bestimmte Anwendungen im Bildungsbereich als hochriskant ein. Das betrifft insbesondere KI-Systeme, die zur Bewertung von Lernergebnissen oder zur Überwachung und Erkennung von verbotenem Verhalten in Prüfungen eingesetzt werden. Diese Systeme unterliegen strengen Dokumentations- und Aufsichtspflichten.

Für dich als Studierenden bedeutet das vor allem: Die Nutzung von KI-Detektoren wie Turnitin wird zunehmend reguliert. Aktuelle Studien zeigen ohnehin, dass diese Detektoren weder genau noch zuverlässig sind. Gleichzeitig steigt aber die Erwartung, dass du den Einsatz von KI transparent machst.

Praktische Tipps: So bleibst du auf der sicheren Seite

Unabhängig davon, welche Regelungen an deiner Hochschule gelten, gibt es bewährte Verhaltensweisen, die dich vor Problemen schützen.

Informiere dich aktiv. Prüfe vor jeder Abgabe, welche KI-Richtlinien für deine Veranstaltung, dein Fach und deine Hochschule gelten. Wenn keine klaren Regeln existieren, frage direkt bei deinen Dozierenden nach.

Dokumentiere deinen KI-Einsatz. Halte fest, welches Tool du wofür verwendet hast. Viele Hochschulen erwarten mittlerweile eine detaillierte Angabe in der Eigenständigkeitserklärung.

Nutze KI als Schreibhilfe, nicht als Ghostwriter. Tools wie fastwrite sind genau dafür konzipiert: Sie arbeiten mit deinen eigenen Quellen, schlagen dir Formulierungen vor und fügen automatisch die passenden Zitationen ein, inklusive Seitenangabe. Damit bleibt die inhaltliche Leistung bei dir, während das Tool den Schreibprozess unterstützt.

Überprüfe jede Quelle. Egal welches Tool du verwendest: Die Verantwortung für die Richtigkeit deiner Quellen liegt immer bei dir. Tools, die auf deiner eigenen hochgeladenen Literatur basieren, bieten hier einen deutlichen Vorteil gegenüber allgemeinen Chatbots, die Quellen erfinden können.

Behalte die rechtlichen Entwicklungen im Blick. Mit dem Inkrafttreten weiterer Bestimmungen der EU-KI-Verordnung im August 2026 werden sich die Rahmenbedingungen weiter verändern.

Fazit

Die KI-Richtlinien an deutschen Universitäten sind im Wandel. Von klaren, zentralen Policies wie in Freiburg oder Osnabrück bis hin zu vollständig dezentralen Ansätzen und fehlenden Regelungen ist alles vertreten. Für Studierende bedeutet das: Du musst dich selbst informieren und Verantwortung übernehmen.

Die gute Nachricht ist, dass der Trend klar in Richtung Ermöglichung geht, nicht in Richtung Verbot. Hochschulen erkennen zunehmend, dass KI-Kompetenz eine Schlüsselqualifikation ist, die im Studium erlernt werden muss. Wer KI-Tools reflektiert, transparent und quellenbasiert einsetzt, hat an den meisten Hochschulen nichts zu befürchten. Spezialisierte Schreibassistenten wie fastwrite, die direkt mit deinen eigenen Quellen arbeiten und automatisch korrekte Zitationen erzeugen, machen es deutlich leichter, die Anforderungen von Hochschulen und EU-KI-Verordnung gleichermaßen zu erfüllen.

.svg)